Goed nieuws: deepfakes kunnen nu gezichtsherkenningstools misleiden

Over deepfakes bestaan voornamelijk zorgen: een namaakfilmpje van een politicus kan leiden tot onterecht negatieve opvattingen over die politicus bijvoorbeeld. Daarnaast zijn er zorgen over afpersing en oplichting: je bent te chanteren met pornobeelden die namaak zijn. Over dat laatste schreven we hier al eerder dat zulke nepvideo’s eerder privacy redden dan bedreigen. Het bestaan van deepfakes betekent immers dat je plausibel kunt ontkennen: jij was het niet, het is een deepfake. Dit wordt versterkt door het nieuws dat deekfakes gezichtsherkenningstools kunnen misleiden.

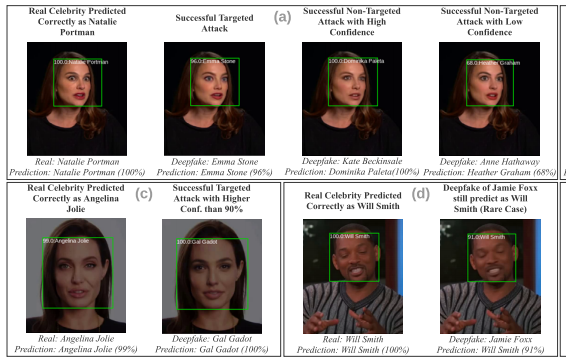

Koreaanse onderzoekers [open toegang] maakten 8119 deepfakes van celebrities en voerden die in in Microsofts Azure Cognitive Services en Amazon’s Rekognition. Die lieten zich inderdaad om de tuin leiden, Microsoft had het mis in 78 procent van de gevallen en Amazon in 69 procent. De onderzoekers zijn bezorgd dat deepfakes gebruikt worden om mensen te imiteren, bijvoorbeeld een student die wil frauderen tijdens een examen of bij phishing-aanvallen.

Phishing is inderdaad een zorgenpuntje: veel mensen trappen nu al in een hulpvraag via WhatsApp, en dat is alleen op basis van geschreven tekst. Het is belangrijk mensen hiervoor te blijven waarschuwen – met of zonder deepfake-technologie.

Het helpt daarbij als mensen bekend zijn met het bestaan van deepfaketechnologie en weten hoe het werkt. Gelukkig doen er al heel veel fake video’s de rondte. Dankzij Snapchat en Instagram zijn we allang gewend aan face swaps. Je kunt jouw gezicht met dat van een vriend verwisselen of zien hoe je eruit ziet als een ander geslacht. Mensen vinden het leuk om hun gezicht te swappen met een celebrity en dat door te sturen aan hun vrienden. Hoe meer van zulke filmpjes we zien, hoe meer we meer weten dat je beeld niet kunt vertrouwen.

Bovendien is het eerder goed nieuws dan slecht dat Microsoft en Amazon nu meer moeite hebben om onze gezichten te herkennen. Gezichtsherkenning maakt massasurveillance van personen in de publieke ruimte mogelijk: in China wordt gezichtsherkenning ingezet om de Oeigoeren te monitoren. Hoe minder goed deze technologie werkt, hoe beter dat is voor onze privacy.

Beeld: scenario’s gebruikt in het onderzoek